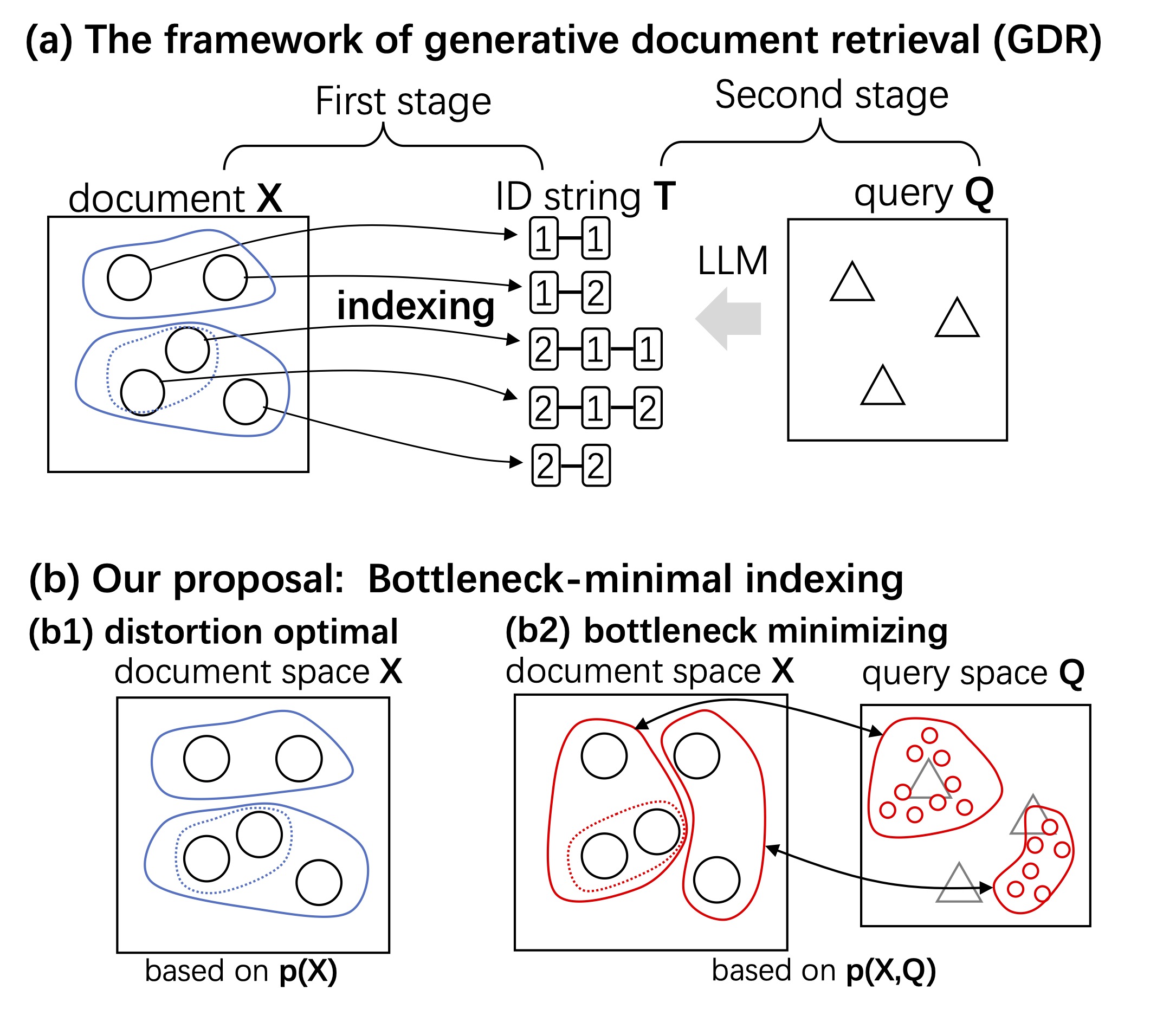

情報理論の視点から生成的文書検索(GDR)を再考し、新しい文書の索引を提案しています。文書をx∈X 、索引をt∈T 、検索クエリq∈Qとする時、GDRでは Q を T にマッピングするようにニューラルネットワークを訓練します。GDRは、文書 X からクエリ Q へ、索引 T を介して、より多くのビットを伝送する系とみなすことができます。シャノンのレート歪み理論を適用することにより、GDRにおける情報伝達ボトルネックを小さくする索引 T を設計することができます。 参考文献

Featured

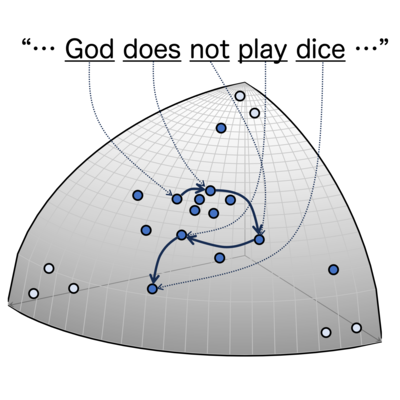

自然言語の相関次元は、大規模言語モデルによって生成された高次元ベクトル列にGrassberger-Procacciaアルゴリズムを適用することで測定されます。この方法は、以前はユークリッド空間でのみ研究されていましたが、本研究では、統計多様体上にFisher-Rao距離を用いて再定式化しました。相関次元は、普遍的に約6.5であることがわかりました。この値は単純な離散ランダム列のそれよりも小さく、Barabási-Albert過程のそれよりも大きいです。 参考文献

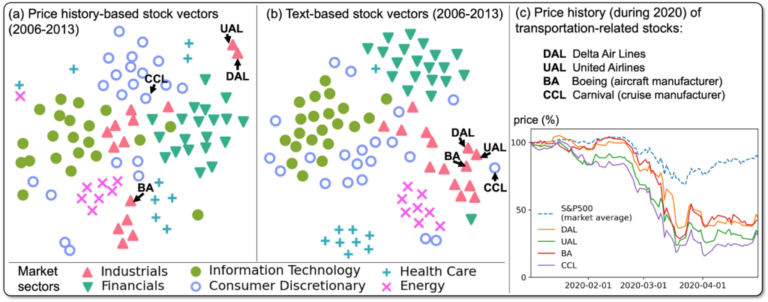

物理経済の理論下では、価格のスケーリング則が知られ、それは市場がなぜ簡単に破綻するのか、 その理由を説明するものです。金融市場の大きな問題の一つは、稀少な事象に起因するリスクの特徴を、 いかに捉えるか、という点にあります。たとえば、コロナ禍は稀少な事象例で、その際の株価の動向は、 過去のデータからモデル化することは難しいのです。この点、新聞などの文書では、 稀な事象を、より強調して記述するものです。このため、価格に加え文書を利用することは、リスクを捉える一つの手段となります。 研究室では、文書データを用いて、経済リスクを計量し応用する方法を研究しています。 参考文献

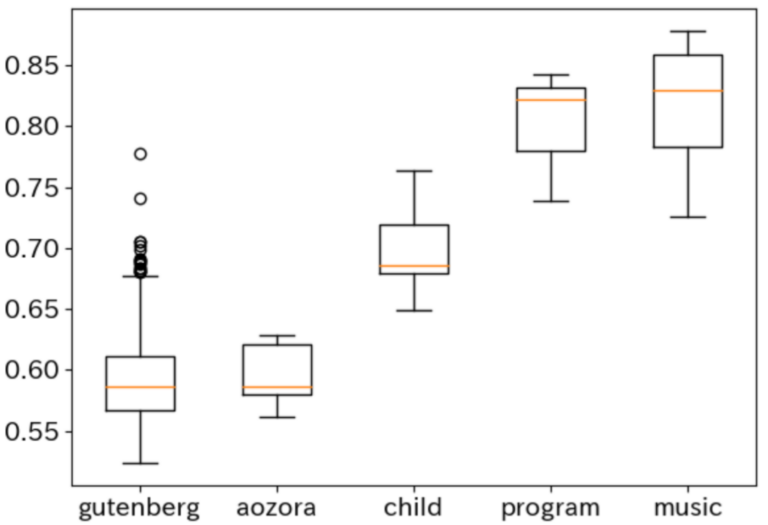

大人に比べて子供の話し言葉はどの程度構造的に複雑なのでしょうか? また、歴史に残る名作は、Wikipediaに比べてどうでしょうか? 言語の構造的複雑さの考察については、文法に対する『チョムスキー階層』が知られ、 書き換えルールの制約によって言語が階層的に捉えられます。 研究室ではこれとは別に、文書に内在するスケーリング則から得られる統計量を利用し、 構造の複雑さを計量する方法を探求しています。 参考文献

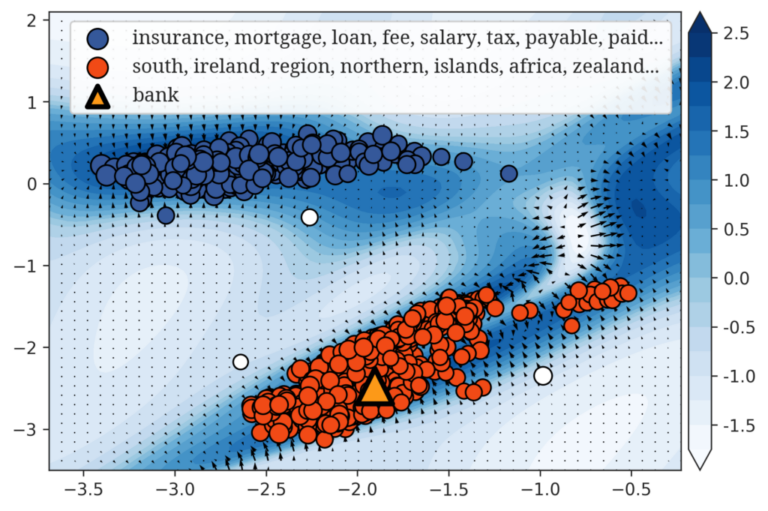

機械学習では単語など文書の要素をベクトルとして表現しなければならず、それを埋め込み表現といいます。 現在の埋め込み表現は、線形ベクトル空間の中に単語をベクトルとして表現しますが、線形空間では、 多義性など単語の持つ非線形な特性を表現することができません。 このため、既存のベクトル表現に代わる数理的な表現を研究しています。 試みとして、FIRE という関数に基づく表現を構築しました。FIREはBERTと同等の性能を有し、単語の意味の数の推定することにおいては、BERTよりも優れている埋め込み表現です。 参考文献